数据和特征决定了机器学习的上限,而模型和算法只是逼近这个上限。

基础概念

GBDT

GBDT (Gradient Boosting Decision Tree) 是机器学习中一个长盛不衰的模型,其主要思想是利用弱分类器(决策树)迭代训练以得到最优模型,该模型具有训练效果好、不易过拟合等优点。

GBDT不仅在工业界应用广泛,通常被用于多分类、点击率预测、搜索排序等任务;在各种数据挖掘竞赛中也是致命武器,据统计Kaggle上的比赛有一半以上的冠军方案都是基于GBDT。

LightGBM

LightGBM(Light Gradient Boosting Machine)是一个实现GBDT算法的框架,支持高效率的并行训练,并且具有更快的训练速度、更低的内存消耗、更好的准确率、支持分布式可以快速处理海量数据等优点。

LightGBM 框架中还包括随机森林和逻辑回归等模型。通常应用于二分类、多分类和排序等场景。

例如:在个性化商品推荐场景中,通常需要做点击预估模型。使用用户过往的行为(点击、曝光未点击、购买等)作为训练数据,来预测用户点击或购买的概率。根据用户行为和用户属性提取一些特征,包括:

类别特征(Categorical Feature):字符串类型,如性别(男/女)。

物品类型:服饰、玩具和电子等。

数值特征(Numrical Feature):整型或浮点型,如用户活跃度或商品价格等。

更多内容可见 LightGBM 中文文档、LightGBM英文文档

导入模块

import numpy as np

import pandas as pd

import lightgbm as lgb

from sklearn.metrics import mean_squared_log_error, mean_absolute_error, mean_squared_error

import tqdm

import sys

import os

import gc

import argparse

import warnings

warnings.filterwarnings('ignore')探索性数据分析

数据挖掘的过程中,数据可视化是发掘数据特征的有力工具。

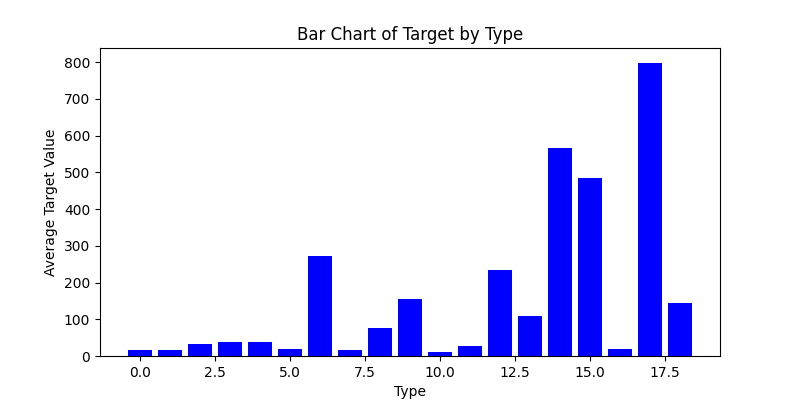

分析不同type类型的目标值变化

# 不同type类型对应target的柱状图

type_target_df = train.groupby('type')['target'].mean().reset_index()

plt.figure(figsize=(8, 4))

plt.bar(type_target_df['type'], type_target_df['target'], color=['blue'])

plt.xlabel('Type')

plt.ylabel('Average Target Value')

plt.title('Bar Chart of Target by Type')

plt.show()

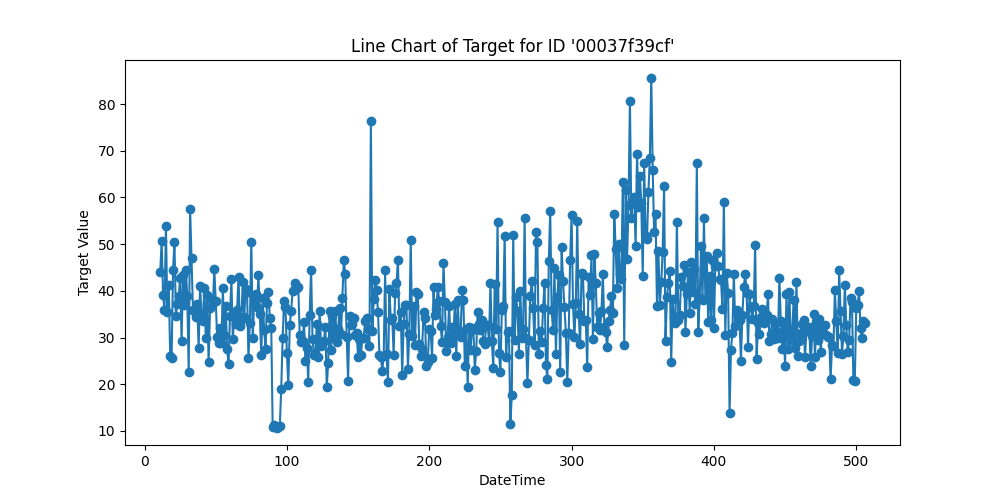

分析某一个id下的目标值随时间变化的曲线

specific_id_df = train[train['id'] == '00037f39cf']

plt.figure(figsize=(10, 5))

plt.plot(specific_id_df['dt'], specific_id_df['target'], marker='o', linestyle='-')

plt.xlabel('DateTime')

plt.ylabel('Target Value')

plt.title("Line Chart of Target for ID '00037f39cf'")

plt.show()

特征工程

教程构建了历史平移特征和窗口统计特征;每种特征都是有理可据的,具体说明如下:

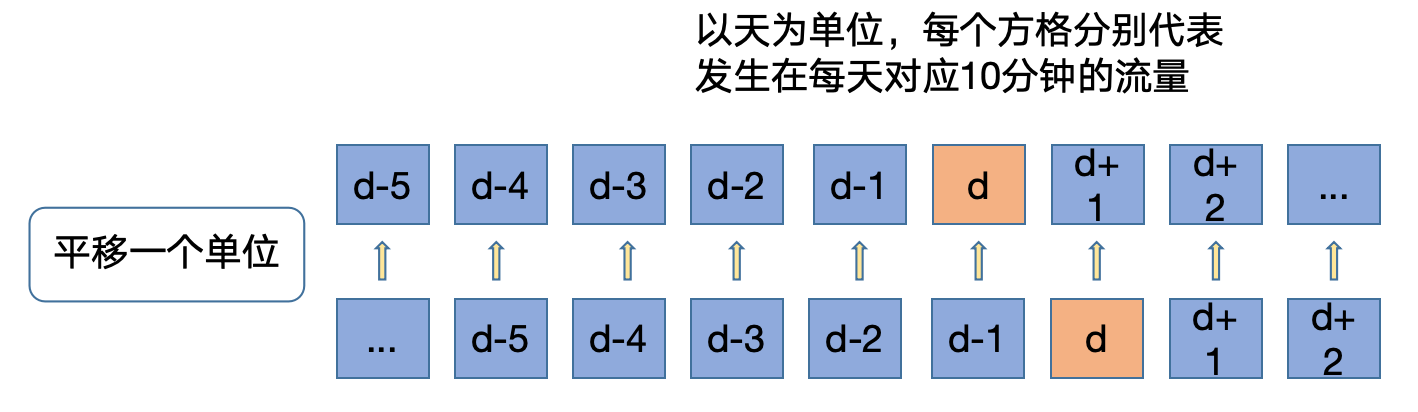

历史平移特征:通过历史平移获取上个阶段的信息;如下图所示,可以将d-1时间的信息给到d时间,d时间信息给到d+1时间,这样就实现了平移一个单位的特征构建。

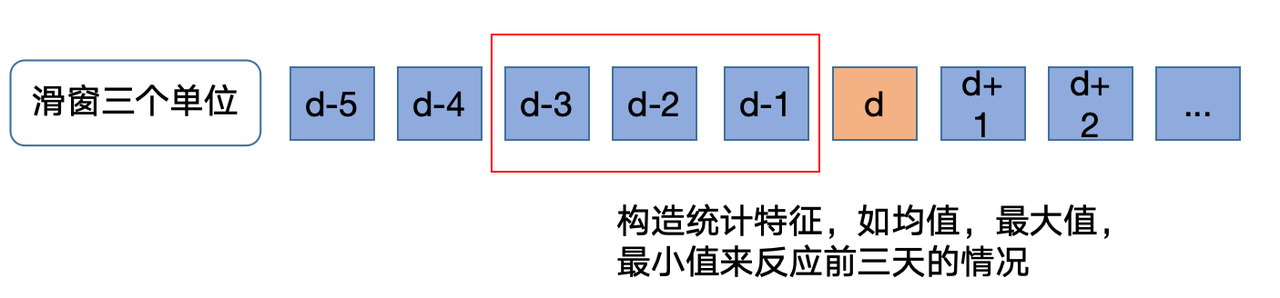

窗口统计特征:窗口统计可以构建不同的窗口大小,然后基于窗口范围进统计均值、最大值、最小值、中位数、方差的信息,可以反映最近阶段数据的变化情况。如下图所示,可以将d时刻之前的三个时间单位的信息进行统计构建特征给我d时刻。

完整代码如下:

# 合并训练数据和测试数据,并进行排序

data = pd.concat([test, train], axis=0, ignore_index=True)

data = data.sort_values(['id','dt'], ascending=False).reset_index(drop=True)

# 前面这两行代码是合并数据,方便后面把已知数据和待求数据放到一起共同编排

# 历史平移

for i in range(10,30):

data[f'last{i}_target'] = data.groupby(['id'])['target'].shift(i)

# 窗口统计

data[f'win3_mean_target'] = (data['last10_target'] + data['last11_target'] + data['last12_target']) / 3

# 进行数据切分

train = data[data.target.notnull()].reset_index(drop=True)

test = data[data.target.isnull()].reset_index(drop=True)

# 确定输入特征

train_cols = [f for f in data.columns if f not in ['id','target']]代码解读:

ignore_index=True表示忽略原来的索引,重新生成新的索引。reset_index(drop=True)表示重置索引,并丢弃原来的索引列。(两次重置索引,是因为相当于重组数据两遍)ascending=False表示降序排序,加上前面的两个键名表示对合并后的数据框按id和dt列进行降序排序。.shift(i):对target列进行滞后操作,滞后期为i。shift(i)的作用是将target列中的值向下移动i个位置。例如,对于shift(10),每个数据点都会被移动到其所在组(按id分组)下方的第 10 个位置。其实就是先把所有单个窗口都求出来,方便后面的窗口统计。窗口统计相当于只计算10,11,12(天前)的目标值

数据切分是因为这前置步骤只是相当于聚合出新的数据特征,然后加入到每一行中而已,所以还是需要拆开放回训练集和测试集。

模型训练与测试集预测

这里选择使用Lightgbm模型,也是通常作为数据挖掘比赛的基线模型,在不需要过程调参的情况的也能得到比较稳定的分数。

另外需要注意的训练集和验证集的构建:因为数据存在时序关系,所以需要严格按照时序进行切分,

这里选择原始给出训练数据集中dt为30之后的数据作为训练数据,之前的数据作为验证数据(训练、验证、预测;把训练集切分作为训练和预测),

这样保证了数据不存在穿越问题(不使用未来数据预测历史数据)。

def time_model(lgb, train_df, test_df, cols):

# 训练集和验证集切分

trn_x, trn_y = train_df[train_df.dt>=31][cols], train_df[train_df.dt>=31]['target']

val_x, val_y = train_df[train_df.dt<=30][cols], train_df[train_df.dt<=30]['target']

# 构建模型输入数据

train_matrix = lgb.Dataset(trn_x, label=trn_y)

valid_matrix = lgb.Dataset(val_x, label=val_y)

# lightgbm参数

lgb_params = {

'boosting_type': 'gbdt',

'objective': 'regression',

'metric': 'mse',

'min_child_weight': 5,

'num_leaves': 2 ** 5,

'lambda_l2': 10,

'feature_fraction': 0.8,

'bagging_fraction': 0.8,

'bagging_freq': 4,

'learning_rate': 0.05,

'seed': 2024,

'nthread' : 16,

'verbose' : -1,

}

# 训练模型

model = lgb.train(lgb_params, train_matrix, 50000, valid_sets=[train_matrix, valid_matrix],

categorical_feature=[], verbose_eval=500, early_stopping_rounds=500)

# 验证集和测试集结果预测

val_pred = model.predict(val_x, num_iteration=model.best_iteration)

test_pred = model.predict(test_df[cols], num_iteration=model.best_iteration)

# 离线分数评估

score = mean_squared_error(val_pred, val_y)

print(score)

return val_pred, test_pred

lgb_oof, lgb_test = time_model(lgb, train, test, train_cols)

# 保存结果文件到本地

test['target'] = lgb_test

test[['id','dt','target']].to_csv('submit.csv', index=None)参考资料:lightgbm中的模型参数也是很值得深究的,以后回来看。

注意事项

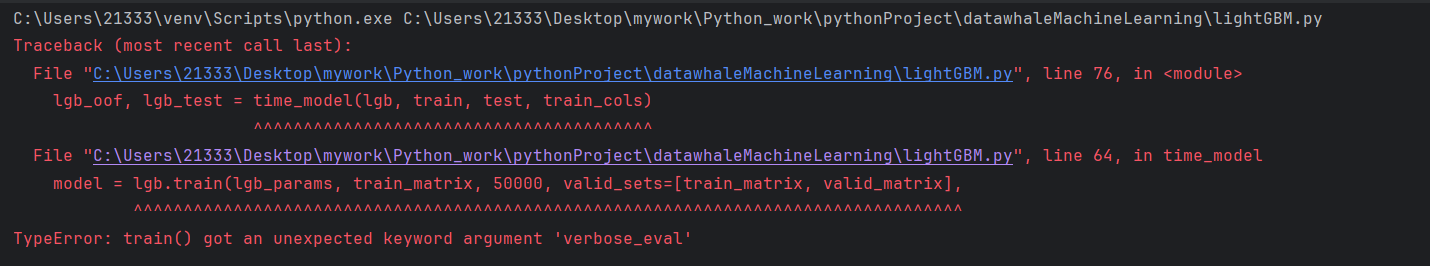

问题1:lightBGM版本错误

解决办法:安装lightBGM==3.3.0的版本

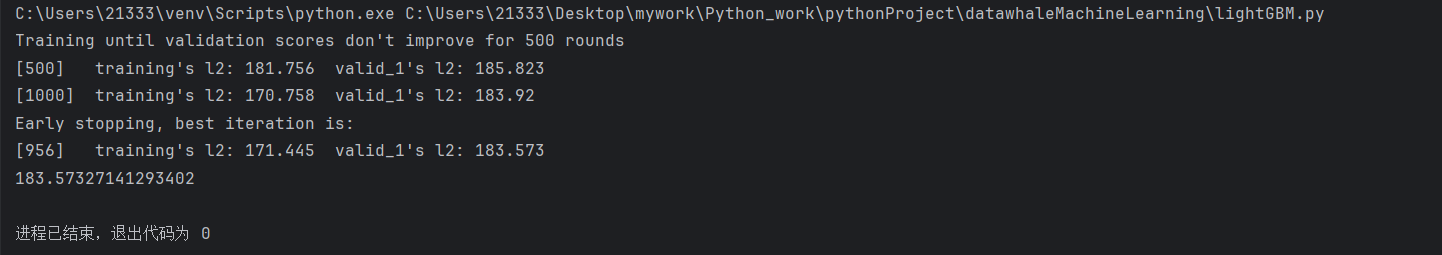

跑通结果

参考资料: